摘要:本文初步探讨了人工智能领域,对Transformer和BERT模型表达了迷茫与探索的态度。文章主要介绍了作者对这两个概念的理解,并表达了对其在实际应用中的困惑和求知欲。通过对Transformer和BERT的基本概念和原理进行初步探究,作者试图揭开人工智能领域的神秘面纱,并寻找解决迷茫的方法。本文旨在分享作者在人工智能领域的初步体验和学习心得,为其他初学者提供参考。

本文目录导读:

自从导师布置了关于Transformer和BERT的两篇论文阅读任务,我陷入了深深的困惑之中,作为一个对人工智能毫无了解的人,这两篇论文的内容对我来说如同天书一般,难以理解,尽管我已经花费了好几天的时间去研读,但依旧感觉一头雾水,面对这样的挑战,我决定深入探索,尝试理解其中的奥秘。

对人工智能的初步认识

作为一个非专业人士,我对人工智能的了解仅限于一些日常接触的智能设备和应用,如智能手机、智能语音助手等,对于人工智能背后的原理和技术,我几乎一无所知,当我接触到Transformer和BERT这两篇论文时,我感到了前所未有的压力。

二、Transformer和BERT论文的阅读困境

在阅读Transformer和BERT论文的过程中,我遇到了许多困难,论文中充斥着大量的专业术语和数学公式,这些对我来说都是陌生的,论文的结构和逻辑也与我平时阅读的普通文章有很大不同,使得我难以把握论文的主旨和要点,由于缺乏相关背景知识,我无法理解论文中的许多概念和理论。

探索理解之路

面对困境,我决定采取以下措施来尝试理解这两篇论文:

1、查阅相关资料:我通过查阅书籍、网上教程和博客文章等方式,了解人工智能、自然语言处理等领域的基础知识。

2、请教他人:我向身边的朋友、同学和导师请教,向他们请教论文中的疑难问题,听取他们的解释和建议。

3、多次阅读论文:我反复阅读论文,尝试从不同的角度理解论文中的内容和思想。

4、逐步深入:我将论文分成若干部分,逐一攻克每个部分的内容,逐步深入理解整个论文。

四、理解Transformer和BERT的关键点

在逐步深入理解的过程中,我发现要理解Transformer和BERT,需要掌握以下几个关键点:

1、深度学习基础知识:了解神经网络、反向传播、优化算法等深度学习基础知识,是理解Transformer和BERT的前提。

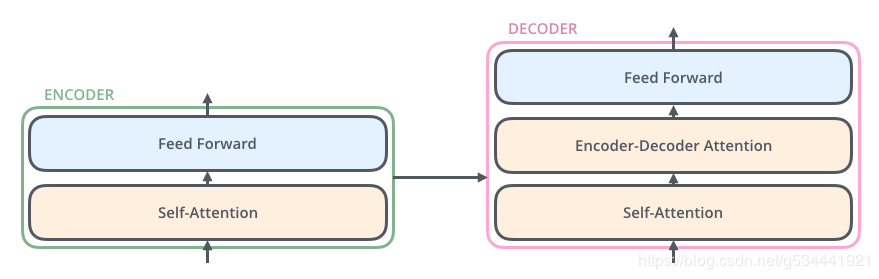

2、注意力机制:理解注意力机制是理解Transformer模型的关键,需要掌握注意力机制的基本原理和应用。

3、BERT模型结构:了解BERT模型的结构和原理,包括预训练、微调等过程,是理解BERT的关键。

4、自然语言处理任务:了解自然语言处理的基本任务和应用场景,有助于理解Transformer和BERT在自然语言处理领域的应用。

收获与展望

虽然我对人工智能毫无了解,但通过努力学习和探索,我逐渐理解了Transformer和BERT的基本原理和应用,这个过程让我深刻认识到学习的重要性,也让我对人工智能领域产生了浓厚的兴趣,我将继续深入学习人工智能相关知识,探索更多领域的应用,为人工智能的发展做出贡献。

这次经历让我认识到,面对陌生的领域和困难,我们需要保持积极的心态和持续学习的精神,通过努力学习、请教他人、查阅相关资料等方式,我们可以逐渐理解并掌握新知识,虽然我现在对人工智能的理解还很浅薄,但我已经对这个领域产生了浓厚的兴趣,我相信,在未来的学习中,我会更好地理解人工智能的原理和应用,为人工智能的发展做出贡献。

京公网安备11000000000001号

京公网安备11000000000001号 京ICP备11000001号

京ICP备11000001号